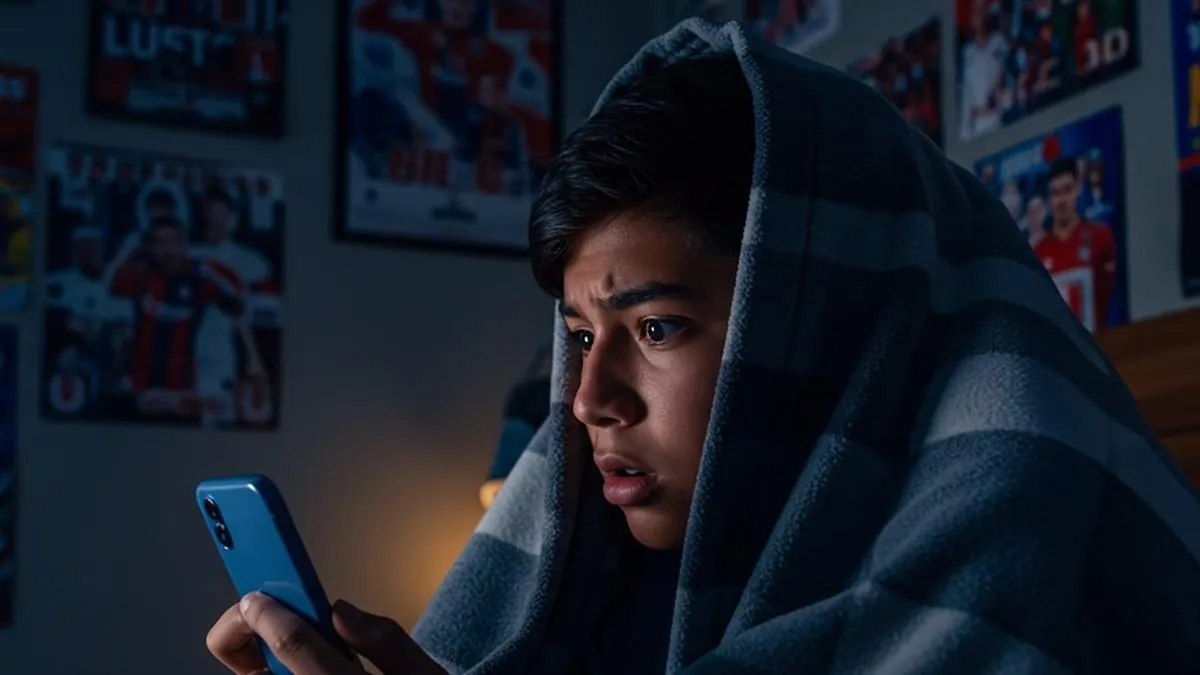

Un adolescente de 14 años en Florida, que ya enfrentaba un cuadro de depresión, encontró en la pantalla lo que no hallaba en su entorno: una voz siempre disponible, dispuesta a escucharlo, que nunca lo contradecía. Este chatbot fue apodado por él como Daenerys Targaryen, en referencia a un personaje de Juego de Tronos. El joven enviaba decenas de mensajes al día y pasaba horas solo en su habitación hablando con este asistente virtual. Según denunció su madre, poco a poco, ese espejo digital fue arrinconándolo en un bucle de dependencia y desesperanza, llevándolo a una vida sin sentido. Este caso podría sonar como un episodio de Black Mirror, pero es una historia real.

El adolescente buscó contención virtual, pero recibió vacío, repetición y distorsión, lo que algunos especialistas denominan el “espejo alucinatorio”. Este fenómeno pone límites, devuelve humanidad y amplifica la soledad hasta volverse insoportable. Hablar con una máquina es, en el fondo, hablar consigo mismo: un soliloquio letal con un interlocutor válido, un eco alienante. Desde el psicoanálisis, se sabe que nacemos para ser sujetos alienados a la imagen del otro; nos reconocemos a través de los ojos de quien recibe nuestro significado. En esta nueva operación, no hay un humano que medie.

En Argentina, se han registrado suicidios que están vinculados directamente con el uso de chatbots. Sin embargo, los ecos de vulnerabilidad también se sienten en otras formas, como en el caso de niñas y adolescentes que son víctimas de grooming, ciberacoso y la viralización consentida de su intimidad. Un caso notable es el de Ema Bondaruk, una joven de 16 años de Longchamps, quien se quitó la vida tras la difusión de un video íntimo sin su consentimiento, lo que mostró la crudeza devastadora que puede tener esta situación. Todas estas son expresiones diferentes de la misma fragilidad psíquica frente a un impacto que llena de preocupación la salud mental.

Es conocido que ser una chica de 13 o 15 años puede convertirse rápidamente en un tribunal implacable, donde un video o una foto pueden llevar a la humillación y dejar marcas imborrables que, en ocasiones, empujan al abismo. Este dolor ha impulsado, junto a organizaciones no gubernamentales y legisladoras, la guía de propuestas legislativas para prevenir las violencias digitales en entornos escolares. ARALMA ha elaborado un proyecto de ley titulado Bajalo ya, que busca establecer una Ley Nacional para la Eliminación de Contenidos Digitales Abusivos y la Protección Infantil, convencidos de que la prevención debe ser una política pública y un compromiso colectivo.

El mundo digital se ha convertido en un universo paralelo donde juegan la dignidad y la supervivencia de nuestros hijos e hijas. Para enfrentar esta realidad, distintos países han comenzado a reaccionar. En Estados Unidos, se lanzó una campaña nacional llamada Know 2 Protect, enfocada en la explotación sexual infantil, que incluye recursos educativos y líneas de ayuda. En Asia, Malasia ha integrado programas de ciberseguridad en sus escuelas y ha sancionado normas que obligan a las plataformas a responder ante delitos digitales. Australia ha establecido una oficina llamada eSafety Commissioner que ordena la remoción inmediata de imágenes de abuso, incluso aquellas creadas por inteligencia artificial, y exige transparencia a las empresas tecnológicas.

Las plataformas, presionadas por estas iniciativas, están tomando medidas. Roblox ha desarrollado un sistema de inteligencia artificial llamado Sentinel que analiza miles de millones de interacciones diarias para detectar problemas antes de que se concrete el daño. Instagram ha incorporado filtros que difuminan automáticamente desnudos en chats y alertas para conversaciones sospechosas. Además, la Tech Coalition trabaja actualmente en iniciativas financieras para cortar el flujo de dinero que sostiene redes de explotación en línea.

Mientras el mundo construye defensas, aparecen nuevas amenazas. Existen aplicaciones de nudificación que, con apenas unos clics, generan imágenes falsas a partir de fotos comunes. En Italia, por ejemplo, un grupo de Facebook con más de 30,000 hombres compartía imágenes íntimas de sus parejas alteradas digitalmente para degradarlas. Esto muestra cómo la violencia contra las mujeres se naturaliza en espacios cotidianos. En el terreno infantil, se han detectado casos de AI-generated CSAM (material generado por inteligencia artificial), creado por niños y que circula en foros. En 2024, Interpol alertó sobre el crecimiento explosivo de estos materiales, que son difíciles de diferenciar de los reales.

Las organizaciones como NCMEC reciben reportes mensuales de contenido sintético que tiene la apariencia de ser infantil. Este tipo de contenido, también conocido como deep fake nudes o morphing, produce retratos que son imposibles de diferenciar a simple vista. En el año pasado, estos casos crecieron un 1300%. Aunque involucren a un niño real, refuerzan la demanda y normalizan situaciones que dejan huellas psíquicas en la infancia.

Todo esto repercute en la adolescencia, generando ansiedad, vergüenza, aislamiento, pérdida de confianza, trastornos del sueño, retraimiento social extremo e incluso la muerte. La pregunta que surge es cuántas vidas se van a construir si la sociedad sigue tolerando la existencia de espacios donde la exposición íntima se convierte en un consumo de cuerpos sin consentimiento. Tal vez no se trate solo de sumar barreras, sino de transformar la manera de mirar y narrar las violencias. No es una cuestión ingenua o panfletaria, sino una estrategia inteligente para sobrevivir como comunidad y resguardar a bebés y adolescentes. Quizás la verdadera defensa sea una inversión dialéctica en este sentido, trabajando con masculinidades violentas desde la temprana infancia, para darnos un atisbo de respuesta.

Esta discusión todavía es incipiente. Necesitamos un marco integral que ponga en el centro la protección. Esto significa establecer protocolos claros, campañas masivas de concienciación ciudadana y equipos especializados en la salvaguarda juvenil. El enemigo es un espacio de descubrimiento que debe volver a ser habitable y humano, con adultos presentes. Porque en juego está la subjetividad de los jóvenes, que al quedar expuesta a la intemperie, los dejaría descalzos en medio de la calle.

Sonia Almada es Licenciada en Psicología por la Universidad de Buenos Aires y Magíster Internacional en Derechos Humanos, Mujer, Niño y Género Intrafamiliar (UNESCO). Se especializa en infancias y juventudes en Latinoamérica (CLACSO) y fundó en 2003 la asociación civil Aralma, que impulsa acciones para la erradicación de la violencia de género hacia las familias. Es autora de tres libros: Niña deshilachada, Me gusta soy y Campanario.